KI-Modelle & Anbieter

FRENZY.BOT bietet Ihnen Zugang zu über 40 kuratierten KI-Modellen via OpenRouter – handverlesen aus Tausenden von verfügbaren Optionen. Anstatt jede experimentelle Version in Ihr Dashboard zu werfen, wählen wir nur produktionsreife Modelle aus, die strengen Qualitätsstandards entsprechen.

So verbinden Sie Ihren KI-Anbieter

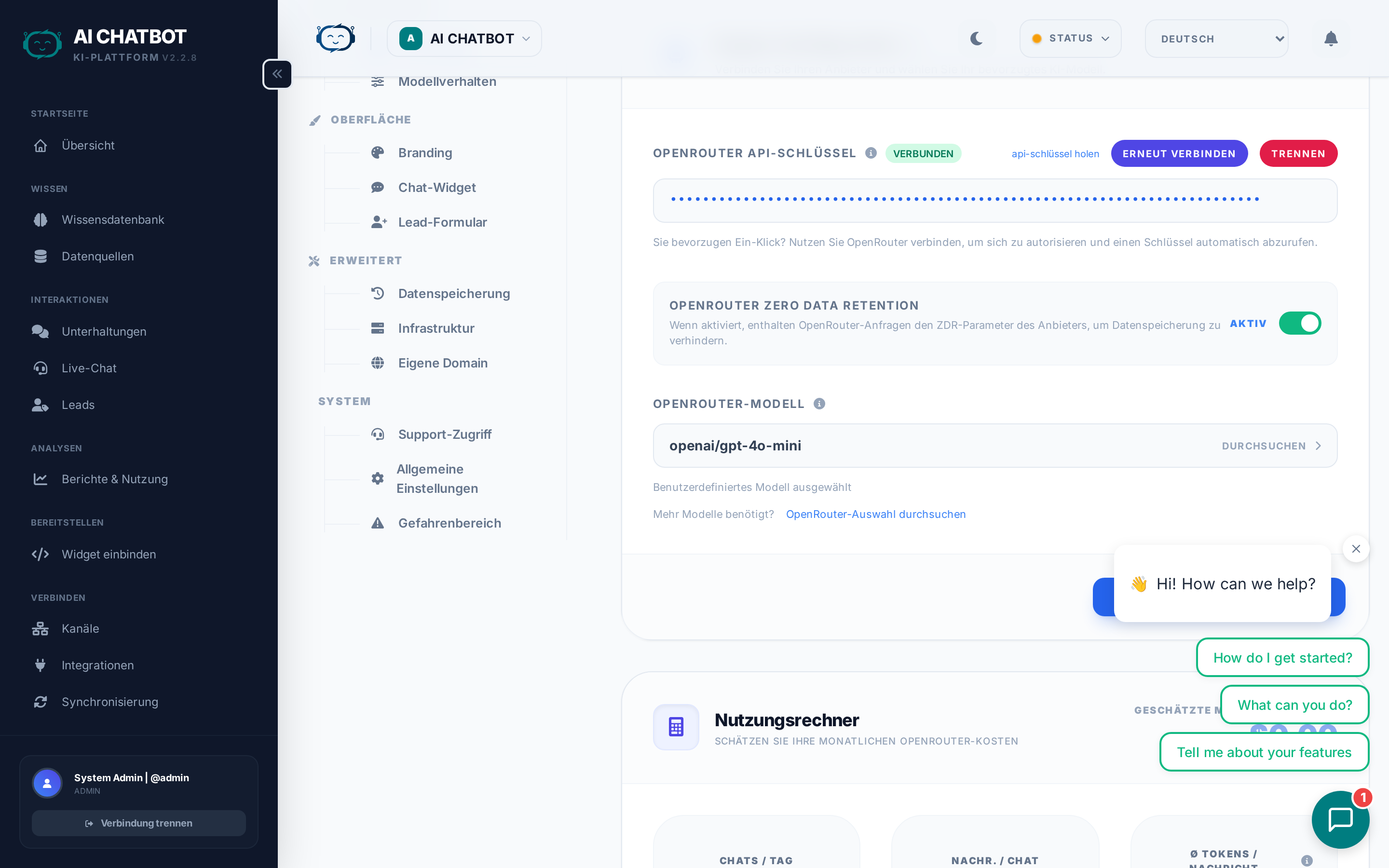

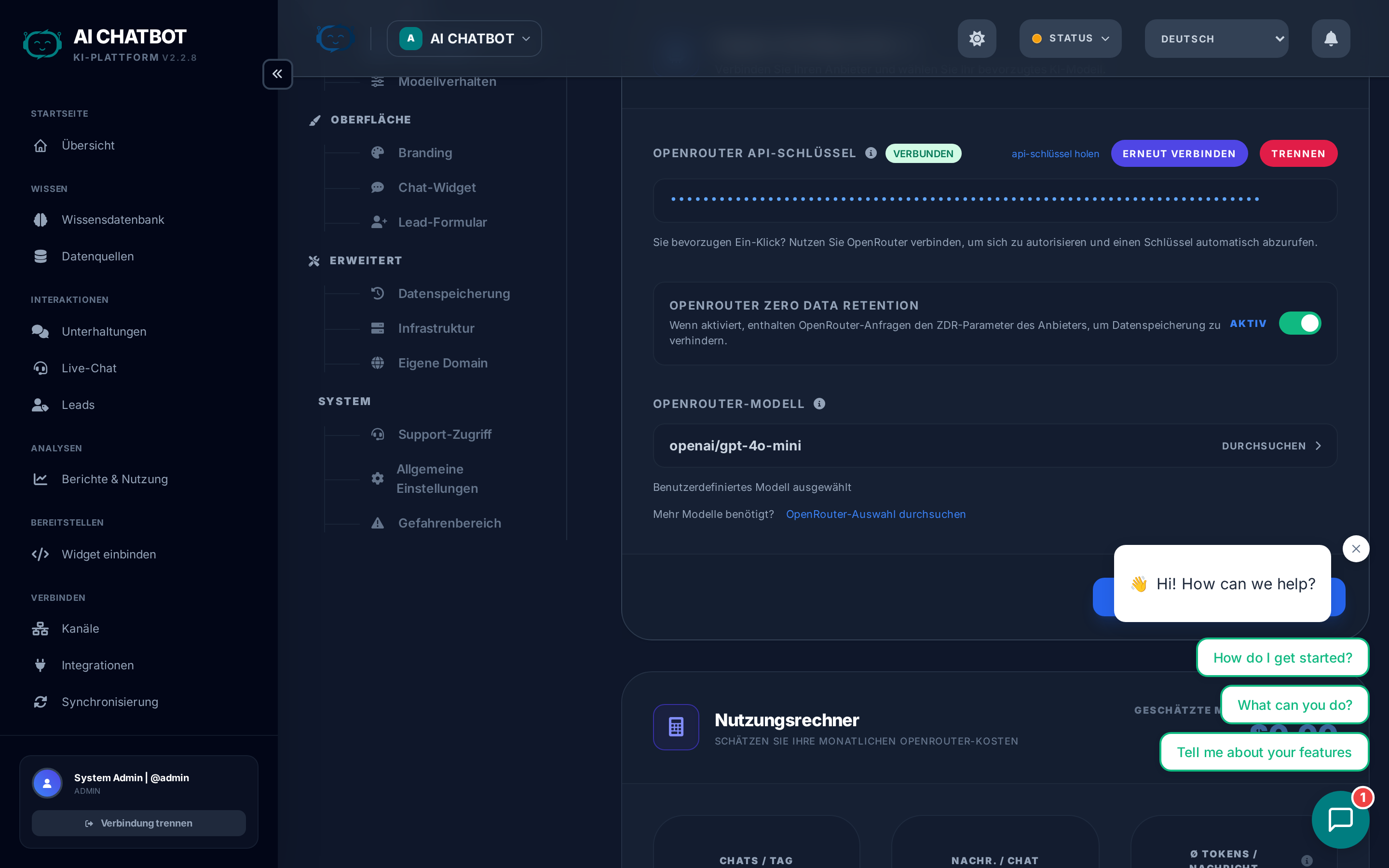

- Gehen Sie zu Settings → AI Engine.

- Klicken Sie auf Connect OpenRouter (OAuth-Flow).

- Autorisieren Sie die Anwendung, wenn Sie dazu aufgefordert werden.

- Ihr API-Key wird sicher in der Datenbank gespeichert – nicht in Konfigurationsdateien.

Das ist alles. Sie können nun jedes Modell aus dem Dropdown-Menü auswählen.

Alternative: API-Key

Wenn Sie OAuth nicht nutzen möchten, können Sie einen OpenRouter API-Key direkt einfügen. Gehen Sie zu openrouter.ai, generieren Sie einen Key und geben Sie ihn unter Settings → AI Engine ein.

So wählen Sie ein Modell aus

Öffnen Sie Settings → AI Engine und nutzen Sie das Dropdown-Menü zur Modellauswahl. Jedes Modell zeigt:

- Modellname und Anbieter (z. B. Claude 3.7 Sonnet von Anthropic)

- Größe des Kontextfensters (wie viel Text das Modell gleichzeitig verarbeiten kann)

- Relative Kostenstufe (Budget, Standard, Premium)

Welches Modell sollte ich wählen?

| Anwendungsfall | Empfohlene Modelle | Warum |

|---|---|---|

| Allgemeiner Kundensupport | GPT-4o, Claude 3.5 Sonnet | Schnell, zuverlässig, kosteneffizient |

| Komplexe Logik & Analyse | Claude 3.7, GPT-4.5 | Überragende Genauigkeit bei schwierigen Fragen |

| Budgetbewusst / Hohes Volumen | DeepSeek V3, GPT-4o Mini | Exzellente Qualität zu einem Bruchteil der Kosten |

| Massive Dokumente (100k+ Wörter) | Gemini 2.5 Pro | Bis zu 1 Mio. Token Kontextfenster |

| Echtzeit-Chat (geringste Latenz) | Gemini Flash, Claude Haiku | Antwortzeiten unter einer Sekunde |

Die "Big Three" Anbieter

Anthropic (Claude)

- Stärken: Überlegene Logik, natürlicher Dialog, exzellente Befolgung von Anweisungen.

- Bestens geeignet für: Kundensupport, Content-Erstellung, komplexe Q&A.

- Modelle: Claude 3.7 Sonnet, Claude 3.5 Sonnet, Claude 3.5 Haiku.

OpenAI (GPT)

- Stärken: Branchenstandard für Zuverlässigkeit, riesiges Ökosystem, konsistente Leistung.

- Bestens geeignet für: Allzweck-KI, Tool-Nutzung, strukturierte Ausgaben.

- Modelle: GPT-4o, GPT-4o Mini, GPT-4.5, o1, o3-mini.

Google (Gemini)

- Stärken: Massive Kontextfenster (bis zu 1 Mio.+ Token), starke multimodale Fähigkeiten.

- Bestens geeignet für: Analyse großer Dokumente, lange Konversationen, Bildverständnis.

- Modelle: Gemini 2.5 Pro, Gemini 2.5 Flash, Gemini 2.0 Flash.

Spezialisierte Modelle

| Anbieter | Modelle | Bestens geeignet für |

|---|---|---|

| xAI (Grok) | Grok 3, Grok 3 Mini | Hochgeschwindigkeitsleistung, Echtzeitwissen |

| DeepSeek | DeepSeek V3, DeepSeek R1 | Intelligenz auf GPT-4-Niveau zu Budgetpreisen |

| Mistral | Mistral Large, Mistral Medium | Europäische KI mit starker mehrsprachiger Unterstützung |

| Meta (Llama) | Llama 3.3, Llama 4 | Transparenz durch Open-Weights, robuste Leistung |

Unsere 4-Säulen-Auswahlkriterien

Jedes Modell in FRENZY.BOT wird anhand von vier Anforderungen bewertet, bevor es der Plattform hinzugefügt wird:

- Zuverlässigkeit – Minimale Ausfallzeiten und Konsistenz. Keine experimentellen oder instabilen Modelle, die mitten im Gespräch scheitern könnten.

- Kontextfenster – Vorzugsweise 128k+ Token. Ein langer Kontext bedeutet, dass der Bot in einer einzigen Antwort auf mehr Inhalte Ihrer Wissensdatenbank zugreifen kann.

- Intelligenz-zu-Kosten-Verhältnis – Wir bevorzugen Modelle, die hohe Qualität ohne unnötige Kosten liefern. DeepSeek und GPT-4o Mini sind Paradebeispiele.

- Geringe Latenz – Flash- und Fast-Varianten sind speziell für den kundenorientierten Echtzeit-Chat enthalten, bei dem jede Sekunde zählt.

Schnelle Integration neuer Modelle

Wenn ein großer Anbieter ein neues State-of-the-Art-Modell veröffentlicht, bewerten und fügen wir es innerhalb von 24 Stunden nach dem stabilen Release hinzu. Sie haben immer Zugriff auf das Neueste und Beste.

Zero Data Retention (ZDR)

FRENZY.BOT unterstützt die Erzwingung von Zero Data Retention (pro Anfrage) über OpenRouter.

Was das bedeutet:

- Wenn ZDR aktiviert ist, werden Ihre Prompts und Antworten vom KI-Anbieter niemals gespeichert.

- Ihre Daten werden niemals für das Modelltraining verwendet.

- Dies wird auf API-Ebene über den OpenRouter-Parameter

provider.zdr: trueerzwungen.

So aktivieren Sie ZDR:

- Gehen Sie zu Settings → AI Engine.

- Aktivieren Sie den Schalter Zero Data Retention.

- Alle nachfolgenden Anfragen enthalten das ZDR-Flag.

ZDR-Modellkompatibilität

Nicht alle Modelle unterstützen ZDR. Wenn es aktiviert ist, leitet FRENZY.BOT Anfragen automatisch nur an Anbieter weiter, die Zero-Data-Retention-Richtlinien einhalten. Überprüfen Sie die OpenRouter ZDR-Dokumentation für die aktuelle Liste.

Einstellungen für das Modellverhalten

Zusätzlich zur Wahl eines Modells können Sie die Art der Antworten feinabstimmen:

Temperature

Steuert Kreativität vs. Präzision.

- Niedrig (0.1–0.3): Faktische, deterministische Antworten. Bestens geeignet für Support- und Richtlinienfragen.

- Mittel (0.4–0.7): Ausgewogen. Ein guter Standard für die meisten Anwendungsfälle.

- Hoch (0.8–1.0): Kreative, abwechslungsreiche Antworten. Bestens für Brainstorming oder lockere Chats.

Top-P

Eine weitere Steuerung für die Antwortvielfalt. Arbeitet zusammen mit der Temperature.

- Niedrigere Werte: Fokussiertere, vorhersehbarere Antworten.

- Höhere Werte: Breitere Palette an Wortwahlen.

Max tokens

Begrenzt die Länge der Antworten. Stellen Sie dies basierend auf Ihrem Anwendungsfall ein:

- Kurze Antworten (256–512): Schnelle Antworten im FAQ-Stil.

- Mittel (1024–2048): Standard-Supportgespräche.

- Lang (4096+): Detaillierte Erklärungen oder technischer Content.

System prompt

Die globalen Anweisungen, die jede Antwort prägen. Hier definieren Sie:

- Die Persönlichkeit und den Tonfall des Bots

- Was er besprechen darf und was nicht

- Wie er mit spezifischen Themen umgehen soll

- Sprach- und Formatierungspräferenzen

Pfad: Settings → Model Behavior → Global System Prompt

Halten Sie Ihren System Prompt fokussiert

Die besten System Prompts sind kurz, klar und richtlinienorientiert. Vermeiden Sie lange, ausschweifende Anweisungen – sie verwässern die Aufmerksamkeit des Modells und verschwenden Token.

Anbieter wechseln oder trennen

Modelle wechseln

Wählen Sie einfach ein anderes Modell aus dem Dropdown-Menü in Settings → AI Engine aus. Die Änderung wird sofort für neue Konversationen wirksam.

OpenRouter trennen

- Gehen Sie zu Settings → AI Engine.

- Klicken Sie auf Disconnect.

- Der Bot wird aufhören, auf Fragen zu antworten, bis ein neuer Anbieter verbunden wird.

Wann man die Verbindung trennen sollte

- Rotation von API-Keys aus Sicherheitsgründen.

- Wechsel zu einem anderen Anbieter-Konto.

- Vorübergehende Deaktivierung von KI-Antworten während Wartungsarbeiten.

FAQ

F: Die KI hat aufgehört zu antworten, nachdem ich das Modell gewechselt habe.

- Einige Modelle können vorübergehend nicht verfügbar sein. Wechseln Sie zu einem anderen Modell und prüfen Sie die Statusseite von OpenRouter.

F: Die Antworten sind zu lang / zu kurz.

- Passen Sie die Max Tokens in Settings → Model Behavior an. Überprüfen Sie auch Ihren System Prompt auf Längenanweisungen.

F: Wie viel kostet jedes Modell?

- Die Preise werden vom Modellanbieter über OpenRouter festgelegt. Prüfen Sie openrouter.ai/models für die aktuellen Preise pro Token. FRENZY.BOT erhebt keinen Aufschlag.

F: Kann ich mein eigenes selbstgehostetes Modell verwenden?

- Derzeit nicht direkt. FRENZY.BOT nutzt OpenRouter als einheitliches Gateway. Wenn Ihr selbstgehostetes Modell über OpenRouter verfügbar ist, wird es funktionieren.