Modèles d'IA & Fournisseurs

FRENZY.BOT vous donne accès à plus de 40 modèles d'IA sélectionnés via OpenRouter — triés sur le volet parmi des milliers d'options disponibles. Au lieu de proposer chaque version expérimentale sur votre tableau de bord, nous sélectionnons uniquement des modèles prêts pour la production qui répondent à des normes de qualité strictes.

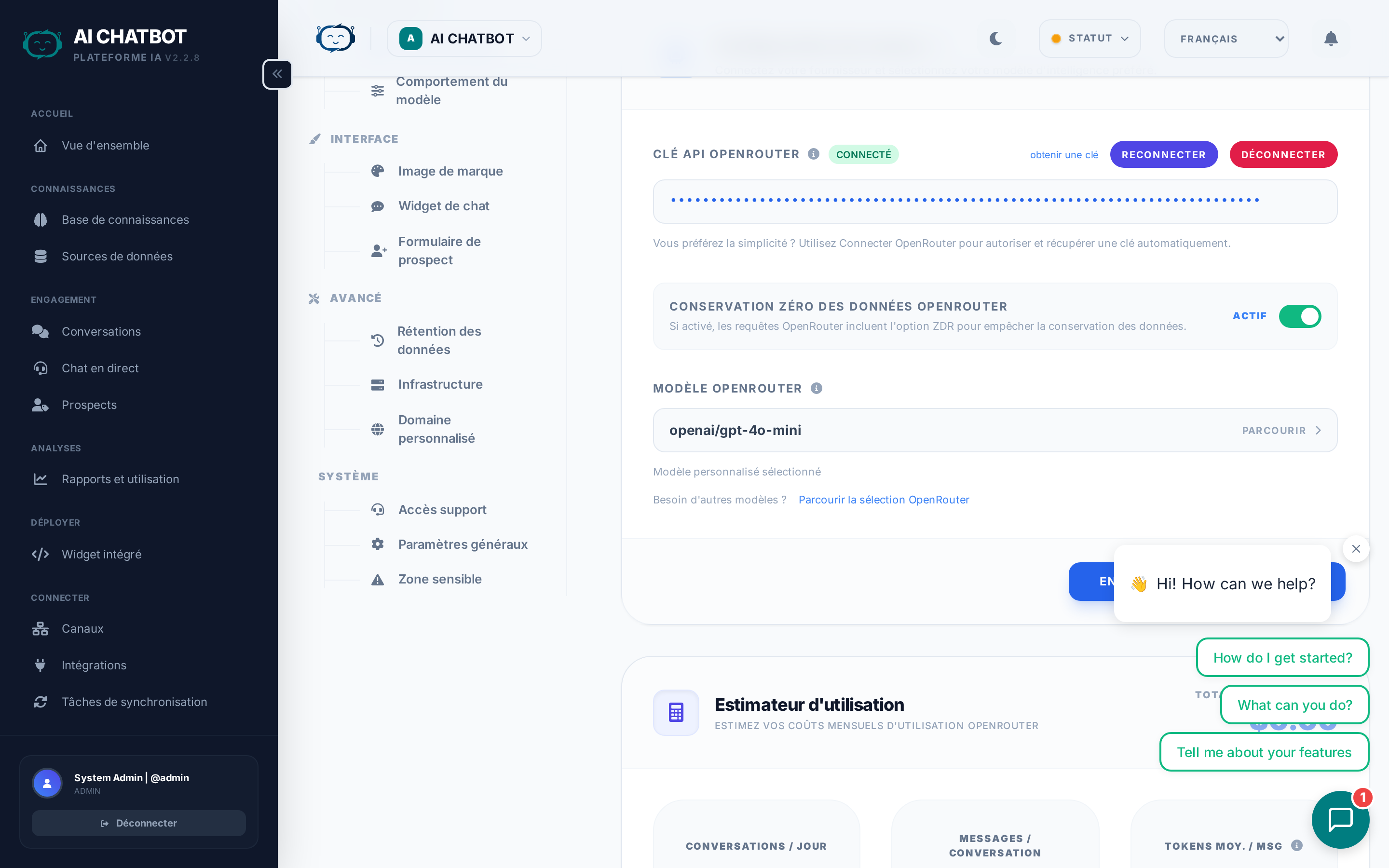

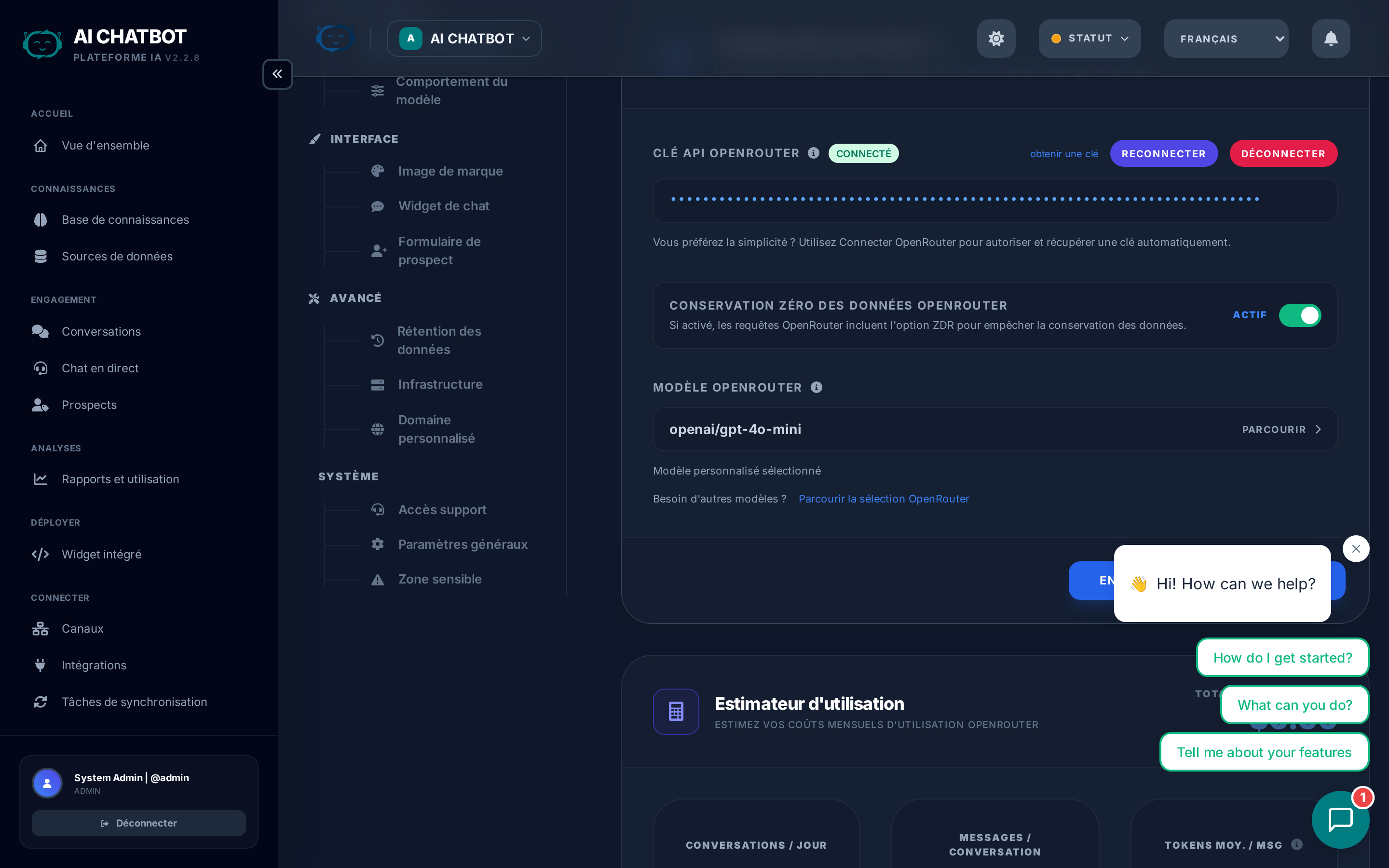

Comment connecter votre fournisseur d'IA

- Allez dans Settings → AI Engine.

- Cliquez sur Connect OpenRouter (flux OAuth).

- Autorisez l'application lorsque vous y êtes invité.

- Votre clé API est stockée de manière sécurisée dans la base de données — pas dans des fichiers de configuration.

C'est tout. Vous pouvez maintenant sélectionner n'importe quel modèle dans le menu déroulant.

Alternative : Clé API

Si vous préférez ne pas utiliser OAuth, vous pouvez coller directement une clé API OpenRouter. Allez sur openrouter.ai, générez une clé et saisissez-la dans Settings → AI Engine.

Comment choisir un modèle

Ouvrez Settings → AI Engine et utilisez le menu déroulant de sélection du modèle. Chaque modèle affiche :

- Nom du modèle et fournisseur (ex: Claude 3.7 Sonnet par Anthropic)

- Taille de la fenêtre de contexte (quantité de texte que le modèle peut traiter en une fois)

- Niveau de coût relatif (économique, standard, premium)

Quel modèle choisir ?

| Cas d'utilisation | Modèles recommandés | Pourquoi |

|---|---|---|

| Support client général | GPT-4o, Claude 3.5 Sonnet | Rapide, fiable, rentable |

| Raisonnement & analyse complexes | Claude 3.7, GPT-4.5 | Précision supérieure sur les questions difficiles |

| Budget limité / volume élevé | DeepSeek V3, GPT-4o Mini | Excellente qualité à une fraction du coût |

| Documents massifs (+100k mots) | Gemini 2.5 Pro | Fenêtre de contexte jusqu'à 1M de tokens |

| Chat en temps réel (latence minimale) | Gemini Flash, Claude Haiku | Temps de réponse inférieur à la seconde |

Les trois grands fournisseurs

Anthropic (Claude)

- Points forts : Raisonnement supérieur, dialogue naturel, excellent respect des instructions.

- Idéal pour : Support client, génération de contenu, questions-réponses complexes.

- Modèles : Claude 3.7 Sonnet, Claude 3.5 Sonnet, Claude 3.5 Haiku.

OpenAI (GPT)

- Points forts : Fiabilité de référence dans l’industrie, vaste écosystème, performances constantes.

- Idéal pour : IA polyvalente, utilisation d'outils, sorties structurées.

- Modèles : GPT-4o, GPT-4o Mini, GPT-4.5, o1, o3-mini.

Google (Gemini)

- Points forts : Fenêtres de contexte massives (jusqu'à 1M+ tokens), fortes capacités multimodales.

- Idéal pour : Analyser des documents volumineux, longues conversations, compréhension d'images.

- Modèles : Gemini 2.5 Pro, Gemini 2.5 Flash, Gemini 2.0 Flash.

Modèles spécialisés

| Fournisseur | Modèles | Idéal pour |

|---|---|---|

| xAI (Grok) | Grok 3, Grok 3 Mini | Performance haute vitesse, connaissances en temps réel |

| DeepSeek | DeepSeek V3, DeepSeek R1 | Intelligence de niveau GPT-4 à prix budget |

| Mistral | Mistral Large, Mistral Medium | IA européenne avec un solide support multilingue |

| Meta (Llama) | Llama 3.3, Llama 4 | Transparence "Open-weights", performances robustes |

Nos 4 piliers de sélection

Chaque modèle dans FRENZY.BOT est évalué selon quatre critères avant d'être ajouté à la plateforme :

- Fiabilité — Disponibilité minimale et cohérence. Aucun modèle expérimental ou instable risquant de s'interrompre en pleine conversation.

- Fenêtre de contexte — 128k+ tokens de préférence. Un contexte long permet au bot de se référer à une plus grande partie de votre base de connaissances en une seule réponse.

- Ratio intelligence-prix — Nous privilégions les modèles qui offrent une grande qualité sans coût inutile. DeepSeek et GPT-4o Mini en sont des exemples parfaits.

- Basse latence — Les variantes Flash et Fast sont spécifiquement incluses pour le chat client en temps réel où chaque seconde compte.

Nouveaux modèles ajoutés rapidement

Lorsqu'un fournisseur majeur publie un nouveau modèle de pointe, nous l'évaluons et l'ajoutons dans les 24 heures suivant sa sortie stable. Vous avez toujours accès au meilleur du moment.

Zéro Rétention de Données (ZDR)

FRENZY.BOT prend en charge l'application de la Zéro Rétention de Données (ZDR) par requête via OpenRouter.

Ce que cela signifie :

- Lorsque la ZDR est activée, vos questions et réponses ne sont jamais stockées par le fournisseur d'IA.

- Vos données ne sont jamais utilisées pour l'entraînement des modèles.

- Cela est imposé au niveau de l'API via le paramètre

provider.zdr: trued'OpenRouter.

Comment activer la ZDR :

- Allez dans Settings → AI Engine.

- Activez l'interrupteur Zero Data Retention.

- Toutes les requêtes ultérieures incluront le flag ZDR.

Compatibilité des modèles ZDR

Tous les modèles ne supportent pas la ZDR. Lorsqu'elle est activée, FRENZY.BOT redirige automatiquement les requêtes uniquement vers les fournisseurs qui respectent les politiques de zéro rétention de données. Consultez la documentation ZDR d'OpenRouter pour la liste actuelle.

Paramètres de comportement du modèle

Au-delà du choix du modèle, vous pouvez affiner sa manière de répondre :

Température

Contrôle la créativité par rapport à la précision.

- Basse (0.1–0.3) : Réponses factuelles, déterministes. Idéal pour le support et les questions sur les processus internes.

- Moyenne (0.4–0.7) : Équilibrée. Un bon réglage par défaut pour la plupart des cas.

- Haute (0.8–1.0) : Réponses créatives, variées. Idéal pour le brainstorming ou les discussions informelles.

Top-P

Un autre contrôle de la diversité des réponses. Fonctionne en parallèle avec la température.

- Valeurs basses : Réponses plus ciblées et prévisibles.

- Valeurs hautes : Gamme de choix de mots plus large.

Max tokens

Limite la longueur des réponses. Définissez ceci en fonction de votre cas d'utilisation :

- Réponses courtes (256–512) : Réponses rapides de type FAQ.

- Moyenne (1024–2048) : Conversations de support standard.

- Longue (4096+) : Explications détaillées ou contenu technique.

Prompt système

Les instructions globales qui façonnent chaque réponse. C'est ici que vous définissez :

- La personnalité et le ton du bot

- Ce dont il doit ou ne doit pas discuter

- Comment il doit traiter des sujets spécifiques

- Les préférences de langue et de formatage

Chemin : Settings → Model Behavior → Global System Prompt

Gardez votre prompt système concis

Les meilleurs prompts système sont courts, clairs et axés sur les consignes. Évitez les instructions longues et diffuses — elles diluent l'attention du modèle et gaspillent des tokens.

Changer ou déconnecter les fournisseurs

Pour changer de modèle

Sélectionnez simplement un modèle différent dans le menu déroulant de Settings → AI Engine. Le changement prend effet immédiatement pour les nouvelles conversations.

Pour déconnecter OpenRouter

- Allez dans Settings → AI Engine.

- Cliquez sur Disconnect.

- Le bot cessera de répondre aux questions jusqu'à ce qu'un nouveau fournisseur soit connecté.

Quand déconnecter

- Renouvellement des clés API pour la sécurité.

- Passage à un autre compte fournisseur.

- Désactivation temporaire des réponses de l'IA pendant une maintenance.

FAQ

Q : L'IA a cessé de répondre après avoir changé de modèle.

- Certains modèles peuvent être temporairement indisponibles. Basculez vers un autre modèle et vérifiez la page d'état d'OpenRouter.

Q : Les réponses sont trop longues / trop courtes.

- Ajustez les Max Tokens dans Settings → Model Behavior. Révisez également vos instructions de longueur dans le prompt système.

Q : Combien coûte chaque modèle ?

- Les prix sont fixés par le fournisseur du modèle via OpenRouter. Consultez openrouter.ai/models pour les tarifs par token en vigueur. FRENZY.BOT n'ajoute aucune marge.

Q : Puis-je utiliser mon propre modèle auto-hébergé ?

- Pas pour le moment. FRENZY.BOT utilise OpenRouter comme passerelle unifiée. Si votre modèle auto-hébergé est disponible via OpenRouter, il fonctionnera.