Report e Utilizzo

Percorso: /dashboard/analytics · Permessi: Modulo Analytics

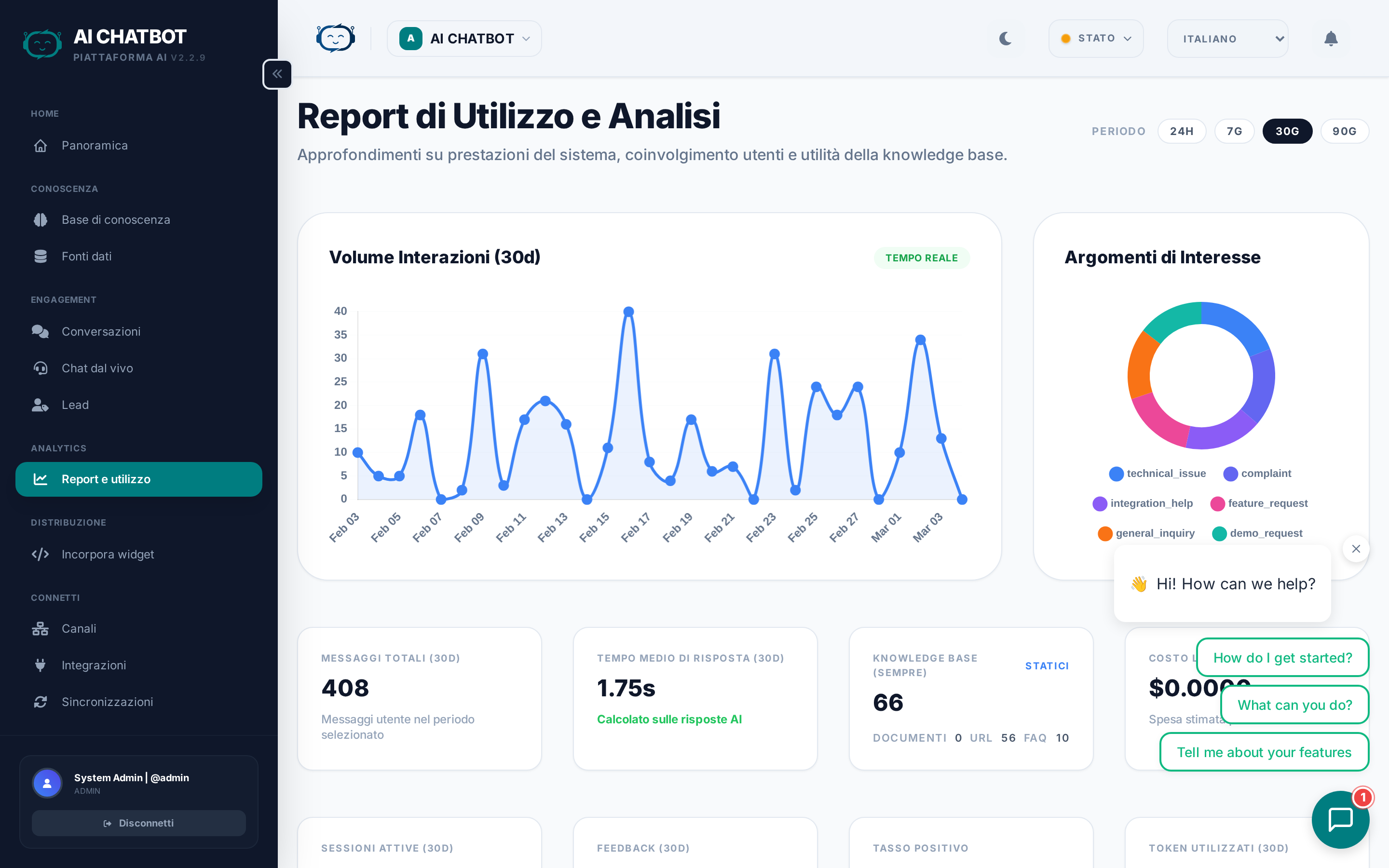

La dashboard Analytics fornisce una panoramica delle prestazioni del tuo assistente AI, di come gli utenti interagiscono con esso e di dove le conversazioni si trasformano in lead. Utilizza questi dati per ottimizzare la tua knowledge base, il modello AI e la strategia di acquisizione lead.

Selettore intervallo di date

Usa i pulsanti dell'intervallo nell'angolo in alto a destra per controllare la finestra temporale di tutti i grafici e le metriche in questa pagina:

| Intervallo | Mostra dati da |

|---|---|

| 24h | Ultime 24 ore |

| 7d | Ultimi 7 giorni |

| 30d | Ultimi 30 giorni (predefinito) |

| 90d | Ultimi 90 giorni |

Tutte le schede, i grafici e i contatori si aggiornano istantaneamente quando cambi intervallo. L'intervallo selezionato è mostrato tra parentesi accanto a ogni intestazione di sezione.

Grafico Volume di Interazione

Il grande grafico in alto a sinistra mostra le sessioni e i messaggi nel tempo come grafico a linee/barre. Ogni punto dati rappresenta un giorno (o un'ora in modalità 24h).

Come leggerlo:

- Trend in crescita → Il tuo bot riceve più utilizzi: assicurati che la knowledge base sia aggiornata.

- Picchi → Correlati a campagne di marketing, lanci di prodotti o eventi di supporto.

- Linea piatta a zero → Il widget potrebbe non essere distribuito o il bot non è raggiungibile.

Il grafico si aggiorna in tempo reale — un badge verde lo conferma.

Engagement Topics

Il grafico a ciambella in alto a destra mostra la distribuzione degli intenti degli utenti — quali categorie di domande le persone pongono più frequentemente. Gli argomenti (topics) vengono rilevati automaticamente dall'AI e visualizzati come ripartizione percentuale.

Come usare queste informazioni:

- Se un argomento domina, aggiungi più FAQ e documenti per quel soggetto.

- Se "generale" o "sconosciuto" è alto, la tua knowledge base potrebbe aver bisogno di una copertura più ampia.

Schede metriche (Riga 1)

La prima riga di schede metriche mostra:

| Scheda | Cosa misura | Cosa monitorare |

|---|---|---|

| Total Messages | Numero di messaggi utente nell'intervallo selezionato | Cali improvvisi possono indicare un problema al widget o al server |

| Avg Response Time | Velocità di risposta dell'AI, in secondi | Sotto i 3s è ottimo; sopra gli 8s — valuta un modello più veloce |

| Knowledge Base | Elementi totali indicizzati (storico), suddivisi in Docs / URL / FAQ | Se è 0, il bot non ha informazioni da cui attingere |

| LLM Cost | Spesa stimata del provider AI per l'intervallo selezionato | Monitoralo per rimanere entro il tuo budget OpenRouter |

Schede metriche (Riga 2)

| Scheda | Cosa misura | Cosa monitorare |

|---|---|---|

| Active Sessions | Sessioni utente distinte nell'intervallo selezionato | Confrontalo con i Messaggi Totali per valutare la profondità della conversazione |

| Feedback | Valutazioni totali ricevute dagli utenti | Un numero basso significa che il modulo feedback potrebbe essere disattivato |

| Positive Rate | Percentuale di feedback positivi (👍) rispetto ai negativi (👎) | Sotto il 70% — esamina le conversazioni negative per trovare lacune |

| Tokens Used | Totale token di input + output consumati | Un alto utilizzo di token aumenta i costi — riduci i Max Tokens o cambia modello |

Funnel di conversione

Il funnel traccia il percorso dei visitatori dall'apertura del widget fino alla conversione in lead. Ogni fase mostra un conteggio e una percentuale di tasso di conversione:

| Fase | Cosa conta | Il tasso mostra |

|---|---|---|

| Widget Opens | L'utente ha cliccato sulla bolla della chat | 100% (base) |

| Chat Starts | L'utente ha inviato il primo messaggio | % di aperture diventate chat |

| Live Chat Sessions | Conversazioni con 3+ scambi | % di chat diventate interazioni profonde |

| Leads Captured | L'utente ha inviato il modulo lead | % di live chat che hanno generato un lead |

Benchmark per una conversione sana

| Conversione | Range ottimale | Se inferiore al range |

|---|---|---|

| Open → Start | 40–60% | Migliora il messaggio di benvenuto e le domande suggerite |

| Start → Live Chat | 30–50% | Migliora la copertura della knowledge base — gli utenti abbandonano |

| Live Chat → Lead | 15–30% | Attiva o ottimizza il modulo lead, aggiungi l'handoff per le conversazioni di valore |

Leggere il funnel

- Alte aperture, pochi inizi → Il widget è visibile ma il testo di benvenuto non è abbastanza coinvolgente per iniziare una conversazione.

- Molti inizi, poche live chat → Gli utenti fanno domande ma non ottengono risposte utili. Esamina le Conversazioni per identificare le lacune.

- Molte live chat, pochi lead → Le conversazioni sono produttive ma non stai catturando i contatti. Attiva il modulo lead in Settings → Lead Form.

Top User Interests

Mostra i primi 5 argomenti su cui gli utenti chiedono informazioni nell'intervallo selezionato, classificati per numero di occorrenze. Ogni argomento è rilevato automaticamente dal classificatore di intenti dell'AI.

Come usare queste informazioni:

- Concentra i miglioramenti della knowledge base sugli argomenti #1 e #2.

- Se appare un argomento che il bot non dovrebbe gestire, aggiorna il system prompt per reindirizzare o rifiutare.

Dettaglio utilizzo LLM

Due pannelli affiancati offrono visibilità sul consumo dei modelli AI:

LLM Usage (per modello)

Mostra ogni modello AI utilizzato nell'intervallo selezionato con:

- Nome del modello (es. DeepSeek/DeepSeek-V3)

- Numero di chiamate API

- Token consumati (in migliaia)

- Costo stimato in USD

Suggerimento: Se un modello sta consumando la maggior parte del budget, valuta il passaggio a un'opzione più economica. Vedi Modelli AI.

LLM Tasks Breakdown (per scopo)

Mostra come i token sono distribuiti tra i diversi compiti di sistema:

| Task | Cosa fa |

|---|---|

| chat | Risposte alle conversazioni principali |

| summary | Riepiloghi delle conversazioni generati dall'AI per i lead |

| intent | Classificazione degli argomenti per le analisi |

| embedding | Indicizzazione della knowledge base |

Se domina "chat", è normale. Se "embedding" è alto, potresti star effettuando re-indicizzazioni troppo frequenti.

Suggerimenti di ottimizzazione

In base a ciò che indicano le analisi:

- Aggiungi FAQ per i principali interessi degli utenti — Questo velocizza le risposte e migliora la precisione per i temi comuni.

- Passa a un modello più veloce se il tempo medio di risposta supera i 5 secondi — consulta Modelli AI per opzioni a bassa latenza come Gemini Flash o Claude Haiku.

- Attiva il modulo lead se le sessioni di live chat sono alte ma l'acquisizione lead è bassa.

- Esamina le conversazioni con valutazioni basse (cliccando dalla scheda Feedback) per identificare dove il bot ha difficoltà e aggiorna la tua knowledge base di conseguenza.

- Affina il tuo system prompt se il tono del bot o il formato delle risposte non soddisfa le aspettative.

- Monitora il costo LLM e passa a modelli economici (DeepSeek V3, GPT-4o Mini) per bot ad alto volume.

FAQ

D: Perché le analisi sono vuote?

- Il bot non ha ancora ricevuto abbastanza sessioni, oppure stai guardando un intervallo di date senza attività. Prova a estendere l'intervallo a 90 giorni.

D: Cosa conta come "sessione di live chat"?

- Una sessione con 3 o più messaggi avanti e indietro (scambi utente + bot). Le sessioni con un solo messaggio sono contate come "inizi chat" ma non come "sessioni live chat".

D: Le analisi sono per singolo bot o globali?

- Per singolo bot. Tutte le analisi sono circoscritte alla workspace del bot attualmente selezionato. Cambia bot usando il menu a discesa della workspace per confrontarli.

D: Ogni quanto vengono aggiornate le analisi?

- Le analisi si aggiornano in tempo reale man mano che avvengono le conversazioni. Aggiorna la pagina per vedere i dati più recenti.

D: Come viene calcolato il costo LLM?

- Il costo è stimato in base al conteggio dei token e al prezzo per token di ogni modello fornito da OpenRouter. FRENZY.BOT non aggiunge alcun ricarico: il costo mostrato corrisponde a quanto addebitato da OpenRouter.