Modelli AI e Provider

FRENZY.BOT ti dà accesso a oltre 40 modelli AI selezionati tramite OpenRouter — scelti con cura tra migliaia di opzioni disponibili. Invece di inserire ogni rilascio sperimentale nella tua dashboard, selezioniamo solo modelli pronti per la produzione che soddisfano rigorosi standard di qualità.

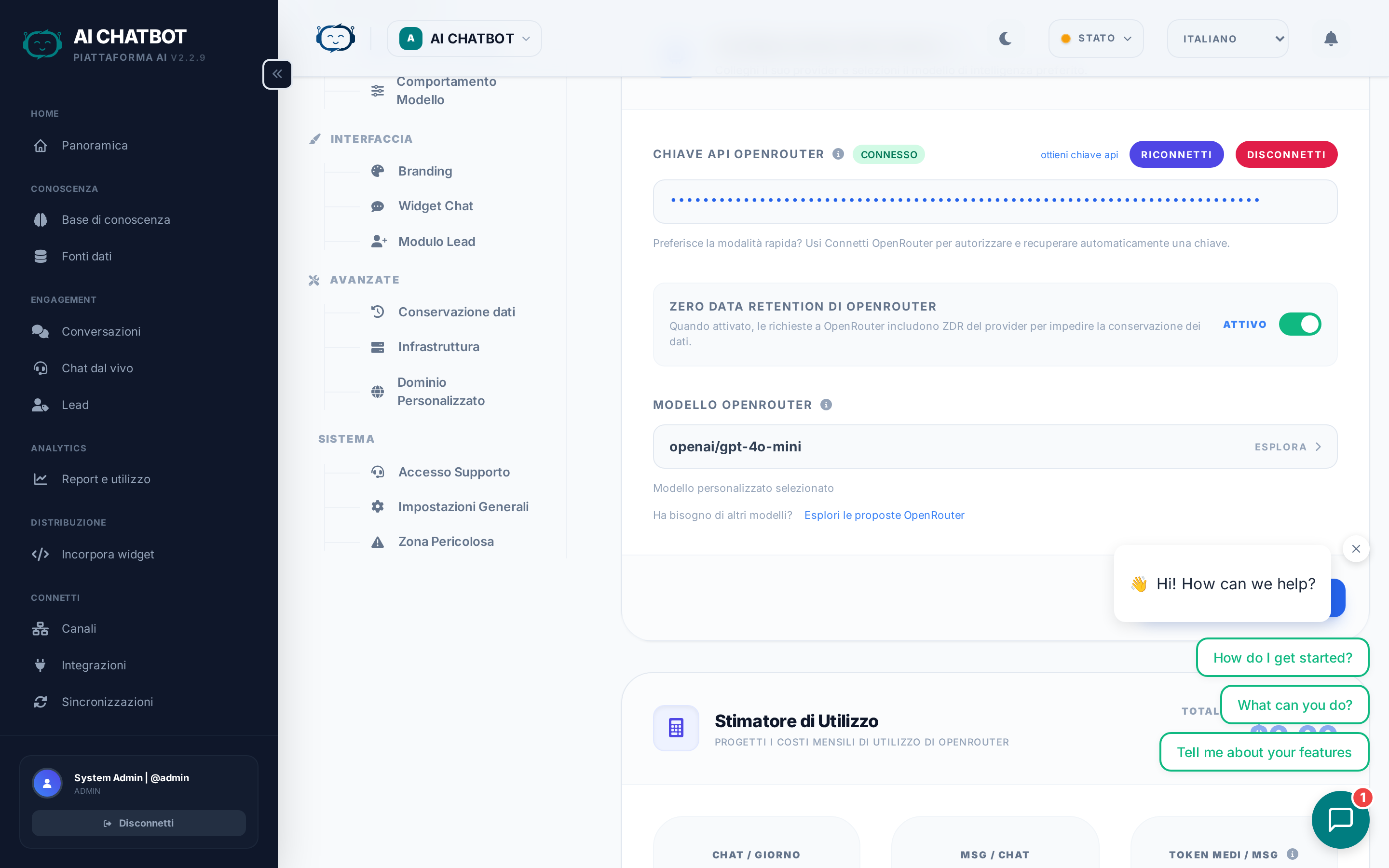

Come connettere il tuo provider AI

- Vai su Settings → AI Engine.

- Clicca su Connect OpenRouter (flusso OAuth).

- Autorizza l'applicazione quando richiesto.

- La tua chiave API viene memorizzata in modo sicuro nel database — non nei file di configurazione.

Tutto qui. Ora puoi selezionare qualsiasi modello dal menu a discesa.

Alternativa: Chiave API

Se preferisci non usare OAuth, puoi incollare direttamente una chiave API di OpenRouter. Vai su openrouter.ai, genera una chiave e inseriscila in Settings → AI Engine.

Come scegliere un modello

Apri Settings → AI Engine e usa il menu a discesa del selettore di modelli. Ogni modello mostra:

- Nome del modello e provider (es. Claude 3.7 Sonnet di Anthropic)

- Dimensione della context window (quanto testo il modello può elaborare contemporaneamente)

- Livello di costo relativo (budget, standard, premium)

Quale modello dovrei scegliere?

| Caso d'uso | Modelli consigliati | Perché |

|---|---|---|

| Supporto clienti generale | GPT-4o, Claude 3.5 Sonnet | Veloce, affidabile, conveniente |

| Ragionamento complesso e analisi | Claude 3.7, GPT-4.5 | Precisione superiore su domande difficili |

| Attento al budget / alto volume | DeepSeek V3, GPT-4o Mini | Qualità eccellente a una frazione del costo |

| Documenti enormi (100k+ parole) | Gemini 2.5 Pro | Context window fino a 1M di token |

| Chat in tempo reale (latenza minima) | Gemini Flash, Claude Haiku | Tempi di risposta inferiori al secondo |

I tre grandi provider

Anthropic (Claude)

- Punti di forza: Ragionamento superiore, dialogo naturale, eccellente nel seguire le istruzioni.

- Ideale per: Supporto clienti, generazione di contenuti, Q&A complessi.

- Modelli: Claude 3.7 Sonnet, Claude 3.5 Sonnet, Claude 3.5 Haiku.

OpenAI (GPT)

- Punti di forza: Affidabilità standard del settore, ecosistema enorme, prestazioni costanti.

- Ideale per: AI generica, uso di tool, output strutturati.

- Modelli: GPT-4o, GPT-4o Mini, GPT-4.5, o1, o3-mini.

Google (Gemini)

- Punti di forza: Context window enormi (fino a oltre 1M di token), forti capacità multimodali.

- Ideale per: Analisi di documenti di grandi dimensioni, conversazioni lunghe, comprensione delle immagini.

- Modelli: Gemini 2.5 Pro, Gemini 2.5 Flash, Gemini 2.0 Flash.

Modelli specializzati

| Provider | Modelli | Ideale per |

|---|---|---|

| xAI (Grok) | Grok 3, Grok 3 Mini | Prestazioni ad alta velocità, conoscenza in tempo reale |

| DeepSeek | DeepSeek V3, DeepSeek R1 | Intelligenza di livello GPT-4 a prezzi budget |

| Mistral | Mistral Large, Mistral Medium | AI europea con forte supporto multilingue |

| Meta (Llama) | Llama 3.3, Llama 4 | Trasparenza open-weights, prestazioni robuste |

I nostri 4 pilastri per la selezione

Ogni modello in FRENZY.BOT viene valutato rispetto a quattro requisiti prima di essere aggiunto alla piattaforma:

- Affidabilità — Uptime minimo e coerenza. Niente modelli sperimentali o instabili che potrebbero fallire a metà conversazione.

- Context window — Preferenza per 128k+ token. Una context window ampia significa che il bot può fare riferimento a una parte maggiore della tua knowledge base in una singola risposta.

- Rapporto intelligenza-prezzo — Diamo priorità ai modelli che offrono alta qualità senza costi inutili. DeepSeek e GPT-4o Mini ne sono i primi esempi.

- Bassa latenza — Le varianti Flash e Fast sono incluse specificamente per chat in tempo reale rivolte ai clienti, dove ogni secondo conta.

Nuovi modelli aggiunti rapidamente

Quando un provider importante rilascia un nuovo modello all'avanguardia, lo valutiamo e lo aggiungiamo entro 24 ore dal rilascio stabile. Avrai sempre accesso al meglio e all'ultimo grido.

Zero Data Retention (ZDR)

FRENZY.BOT supporta l'applicazione della Zero Data Retention per singola richiesta tramite OpenRouter.

Cosa significa:

- Quando la ZDR è abilitata, i tuoi prompt e le tue risposte non vengono mai memorizzati dal provider AI.

- I tuoi dati non vengono mai utilizzati per l'addestramento dei modelli.

- Questo viene imposto a livello API tramite il parametro

provider.zdr: truedi OpenRouter.

Come abilitare la ZDR:

- Vai su Settings → AI Engine.

- Attiva l'interruttore Zero Data Retention.

- Tutte le richieste successive includeranno il flag ZDR.

Compatibilità modelli ZDR

Non tutti i modelli supportano la ZDR. Quando abilitata, FRENZY.BOT instrada automaticamente le richieste solo ai provider che onorano le policy di zero data retention. Consulta la documentazione ZDR di OpenRouter per l'elenco aggiornato.

Impostazioni di comportamento del modello

Oltre a scegliere un modello, puoi perfezionare il modo in cui risponde:

Temperatura

Controlla la creatività rispetto alla precisione.

- Bassa (0.1–0.3): Risposte fattuali e deterministiche. Ideale per supporto e domande sulle policy.

- Media (0.4–0.7): Bilanciata. Un buon default per la maggior parte dei casi d'uso.

- Alta (0.8–1.0): Risposte creative e variegate. Ideale per brainstorming o chat informali.

Top-P

Un altro controllo per la diversità delle risposte. Lavora insieme alla temperatura.

- Valori più bassi: Risposte più focalizzate e prevedibili.

- Valori più alti: Gamma più ampia di scelte lessicali.

Max tokens

Limita la lunghezza delle risposte. Impostalo in base al tuo caso d'uso:

- Risposte brevi (256–512): Risposte rapide in stile FAQ.

- Medie (1024–2048): Conversazioni di supporto standard.

- Lunghe (4096+): Spiegazioni dettagliate o contenuti tecnici.

System prompt

Le istruzioni globali che danno forma a ogni risposta. Qui è dove definisci:

- La personalità e il tono del bot

- Cosa dovrebbe e non dovrebbe discutere

- Come dovrebbe gestire argomenti specifici

- Preferenze di lingua e formattazione

Percorso: Settings → Model Behavior → Global System Prompt

Mantieni il tuo system prompt focalizzato

I migliori system prompt sono brevi, chiari e focalizzati sulle policy. Evita istruzioni lunghe e prolisse: diluiscono l'attenzione del modello e sprecano token.

Cambiare o disconnettere i provider

Per cambiare modello

Seleziona semplicemente un modello diverso dal menu a discesa in Settings → AI Engine. La modifica ha effetto immediato per le nuove conversazioni.

Per disconnettere OpenRouter

- Vai su Settings → AI Engine.

- Clicca su Disconnect.

- Il bot smetterà di rispondere alle domande finché non verrà connesso un nuovo provider.

Quando disconnettere

- Rotazione delle chiavi API per sicurezza.

- Passaggio a un account provider diverso.

- Disabilitazione temporanea delle risposte AI durante la manutenzione.

FAQ

D: L'AI ha smesso di rispondere dopo che ho cambiato modello.

- Alcuni modelli potrebbero essere temporaneamente non disponibili. Passa a un modello diverso e controlla la pagina di stato di OpenRouter.

D: Le risposte sono troppo lunghe / troppo brevi.

- Regola i Max Tokens in Settings → Model Behavior. Controlla anche il tuo system prompt per eventuali istruzioni sulla lunghezza.

D: Quanto costa ogni modello?

- I prezzi sono stabiliti dal provider del modello tramite OpenRouter. Controlla openrouter.ai/models per i prezzi attuali per token. FRENZY.BOT non aggiunge alcun ricarico.

D: Posso usare il mio modello self-hosted?

- Al momento no. FRENZY.BOT utilizza OpenRouter come gateway unificato. Se il tuo modello self-hosted è disponibile tramite OpenRouter, funzionerà.