Relatórios & Uso

Caminho: /dashboard/analytics · Permissão: Módulo de Analytics

O dashboard de Analytics fornece insights sobre o desempenho do seu assistente de IA, como os usuários interagem com ele e onde as conversas se convertem em leads. Use esses dados para otimizar sua base de conhecimento, o modelo de IA e sua estratégia de captura de leads.

Seletor de intervalo de datas

Use os botões de intervalo no canto superior direito para controlar a janela de tempo de todos os gráficos e métricas desta página:

| Intervalo | Mostra dados de |

|---|---|

| 24h | Das últimas 24 horas |

| 7d | Dos últimos 7 dias |

| 30d | Dos últimos 30 dias (padrão) |

| 90d | Dos últimos 90 dias |

Todos os cartões, gráficos e contadores são atualizados instantaneamente ao alterar os intervalos. O intervalo selecionado é exibido entre parênteses ao lado de cada cabeçalho de seção.

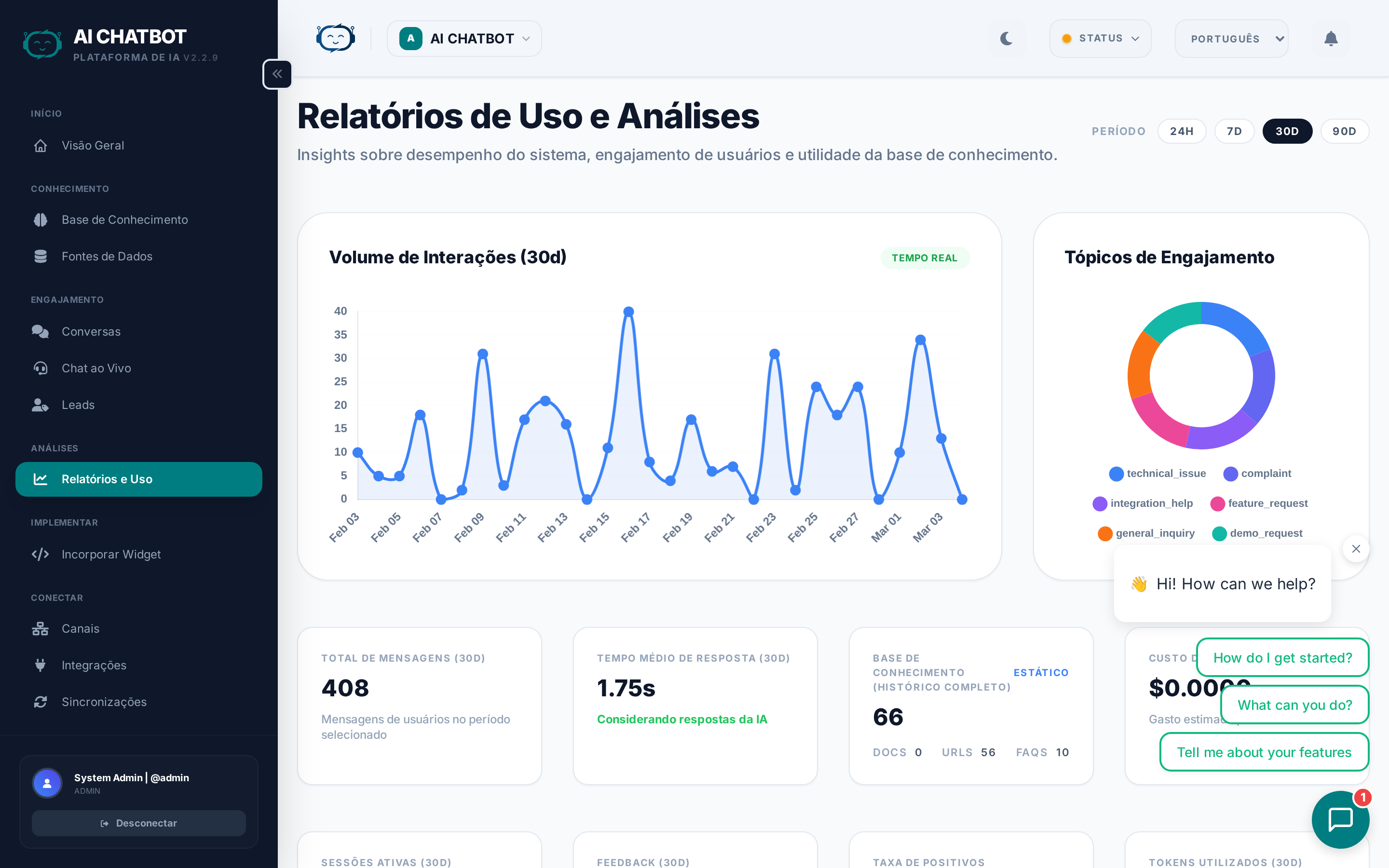

Gráfico de Volume de Interação

O gráfico grande no canto superior esquerdo mostra sessões e mensagens ao longo do tempo como um gráfico de linha/barra. Cada ponto de dado representa um dia (ou uma hora no modo 24h).

Como interpretá-lo:

- Tendência de alta → Seu bot está sendo mais utilizado — certifique-se de que a base de conhecimento acompanhe a demanda.

- Picos → Correlacionam-se com campanhas de marketing, lançamentos de produtos ou eventos de suporte.

- Linha estável em zero → O widget pode não estar implantado ou o bot não está acessível.

O gráfico é atualizado em tempo real — um selo verde confirma isso.

Tópicos de Engajamento

O gráfico de rosca no canto superior direito mostra a distribuição das intenções dos usuários — quais categorias de perguntas as pessoas estão fazendo com mais frequência. Os tópicos são detectados automaticamente pela IA e exibidos como uma porcentagem detalhada.

Como usar isso:

- Se um tópico dominar, adicione mais FAQs e documentos sobre esse assunto.

- Se "geral" ou "desconhecido" estiver alto, sua base de conhecimento pode precisar de uma cobertura mais ampla.

Cartões de métricas (Linha 1)

A primeira linha de cartões de métricas mostra:

| Cartão | O que mede | O que observar |

|---|---|---|

| Total de Mensagens | Número de mensagens de usuários no intervalo selecionado | Quedas repentinas podem indicar um problema no widget ou no servidor |

| Tempo Médio de Resposta | Quão rápido a IA responde, em segundos | Abaixo de 3s é bom; acima de 8s — considere um modelo mais rápido |

| Base de Conhecimento | Total de itens indexados (histórico), detalhado por Docs / URLs / FAQs | Se estiver em 0, o bot não tem conteúdo para responder |

| Custo de LLM | Gasto estimado do provedor de IA para o intervalo selecionado | Monitore isso para permanecer dentro do seu orçamento no OpenRouter |

Cartões de métricas (Linha 2)

| Cartão | O que mede | O que observar |

|---|---|---|

| Sessões Ativas | Sessões de usuários distintas no intervalo selecionado | Compare com o Total de Mensagens para avaliar a profundidade da conversa |

| Feedback | Total de avaliações de usuários recebidas | Números baixos significam que o módulo de feedback pode estar desativado |

| Taxa Positiva | Porcentagem de feedbacks positivos (👍) vs negativos (👎) | Abaixo de 70% — analise conversas negativas para encontrar lacunas |

| Tokens Utilizados | Soma de tokens de entrada + saída consumidos | Alto uso de tokens eleva o custo — reduza o Max Tokens ou mude de modelo |

Funil de conversão

O funil rastreia como os visitantes progridem desde a abertura do widget até se tornarem um lead. Cada etapa mostra uma contagem e uma porcentagem da taxa de conversão:

| Etapa | O que conta | A taxa mostra |

|---|---|---|

| Aberturas do Widget | Usuário clicou na bolha de chat | 100% (base) |

| Inícios de Chat | Usuário enviou sua primeira mensagem | % de aberturas que se tornaram chats |

| Sessões de Chat ao Vivo | Conversas com 3 ou mais trocas | % de chats que se tornaram engajados |

| Leads Capturados | Usuário enviou o formulário de lead | % de chats ao vivo que capturaram um lead |

Referências de conversão saudável

| Conversão | Faixa saudável | Se estiver abaixo da faixa |

|---|---|---|

| Abertura → Início | 40–60% | Melhore sua mensagem de boas-vindas e perguntas sugeridas |

| Início → Chat ao Vivo | 30–50% | Melhore a cobertura da base de conhecimento — os usuários estão desistindo |

| Chat ao Vivo → Lead | 15–30% | Ative ou otimize o formulário de leads, adicione transbordo para conversas de alto valor |

Interpretando o funil

- Altas aberturas, baixos inícios → O widget está visível, mas o texto de boas-vindas não é atraente o suficiente para iniciar uma conversa.

- Altos inícios, baixos chats ao vivo → Os usuários estão fazendo perguntas, mas não recebem respostas úteis. Revise Conversas para identificar lacunas.

- Altos chats ao vivo, baixos leads → As conversas são produtivas, mas você não está capturando informações de contato. Ative o formulário de leads em Configurações → Formulário de Lead.

Principais Interesses dos Usuários

Mostra os 5 principais tópicos sobre os quais os usuários estão perguntando no intervalo selecionado, classificados por contagem de acessos. Cada tópico é detectado automaticamente pelo classificador de intenções da IA.

Como usar isso:

- Foque as melhorias da sua base de conhecimento nos tópicos nº 1 e nº 2.

- Se aparecer um tópico que seu bot não deve tratar, atualize o prompt do sistema para redirecionar ou recusar.

Detalhamento de uso de LLM

Dois painéis lado a lado oferecem visibilidade sobre o consumo dos modelos de IA:

Uso de LLM (por modelo)

Mostra cada modelo de IA usado no intervalo selecionado com:

- Nome do modelo (ex: DeepSeek/DeepSeek-V3)

- Número de chamadas de API

- Tokens consumidos (em milhares)

- Custo estimado em USD

Dica: Se um modelo estiver consumindo a maior parte do seu orçamento, considere mudar para uma opção mais econômica. Veja Modelos de IA.

Detalhamento de Tarefas de LLM (por finalidade)

Mostra como os tokens estão distribuídos entre as diferentes tarefas do sistema:

| Tarefa | O que faz |

|---|---|

| chat | Respostas principais da conversa |

| summary | Resumos de conversa gerados por IA para leads |

| intent | Classificação de tópicos para analytics |

| embedding | Indexação da base de conhecimento |

Se o "chat" dominar, é normal. Se o "embedding" estiver alto, você pode estar reindexando com muita frequência.

Dicas de otimização

Com base no que o analytics informa:

- Adicione FAQs para os principais interesses dos usuários — Isso agiliza as respostas e melhora a precisão em tópicos comuns.

- Mude para um modelo mais rápido se o tempo médio de resposta exceder 5 segundos — veja Modelos de IA para opções de baixa latência como Gemini Flash ou Claude Haiku.

- Ative o formulário de lead se as sessões de chat ao vivo forem altas, mas a captura de leads for baixa.

- Revise conversas com baixa avaliação (clique no cartão de Feedback) para identificar onde o bot tem dificuldades e atualize sua base de conhecimento adequadamente.

- Refine seu prompt do sistema se o tom do bot ou o formato da resposta não estiver atendendo às expectativas.

- Monitore o custo de LLM e mude para modelos econômicos (DeepSeek V3, GPT-4o Mini) para bots de alto volume.

FAQ

P: Por que o analytics está em branco?

- O bot ainda não recebeu sessões suficientes, ou você está visualizando um intervalo de datas sem atividade. Tente expandir o intervalo para 90 dias.

P: O que conta como uma "sessão de chat ao vivo"?

- Uma sessão com 3 ou mais mensagens de ida e volta (trocas entre usuário + bot). Sessões de mensagem única são contadas como "inícios de chat", mas não como "sessões de chat ao vivo".

P: O analytics é por bot ou global?

- Por bot. Todos os dados de analytics são restritos ao workspace do bot selecionado no momento. Alterne entre os bots usando o menu suspenso de workspace para comparar.

P: Com que frequência o analytics é atualizado?

- O analytics é atualizado em tempo real conforme as conversas acontecem. Atualize a página para ver os dados mais recentes.

P: Como o custo do LLM é calculado?

- O custo é estimado com base na contagem de tokens e no preço por token de cada modelo no OpenRouter. O FRENZY.BOT não adiciona margem de lucro — o custo exibido corresponde ao cobrado pelo OpenRouter.