Modelos de IA e Provedores

O FRENZY.BOT oferece acesso a mais de 40 modelos de IA selecionados através do OpenRouter — escolhidos a dedo entre milhares de opções disponíveis. Em vez de despejar cada lançamento experimental no seu painel, selecionamos apenas modelos prontos para produção que atendem a rigorosos padrões de qualidade.

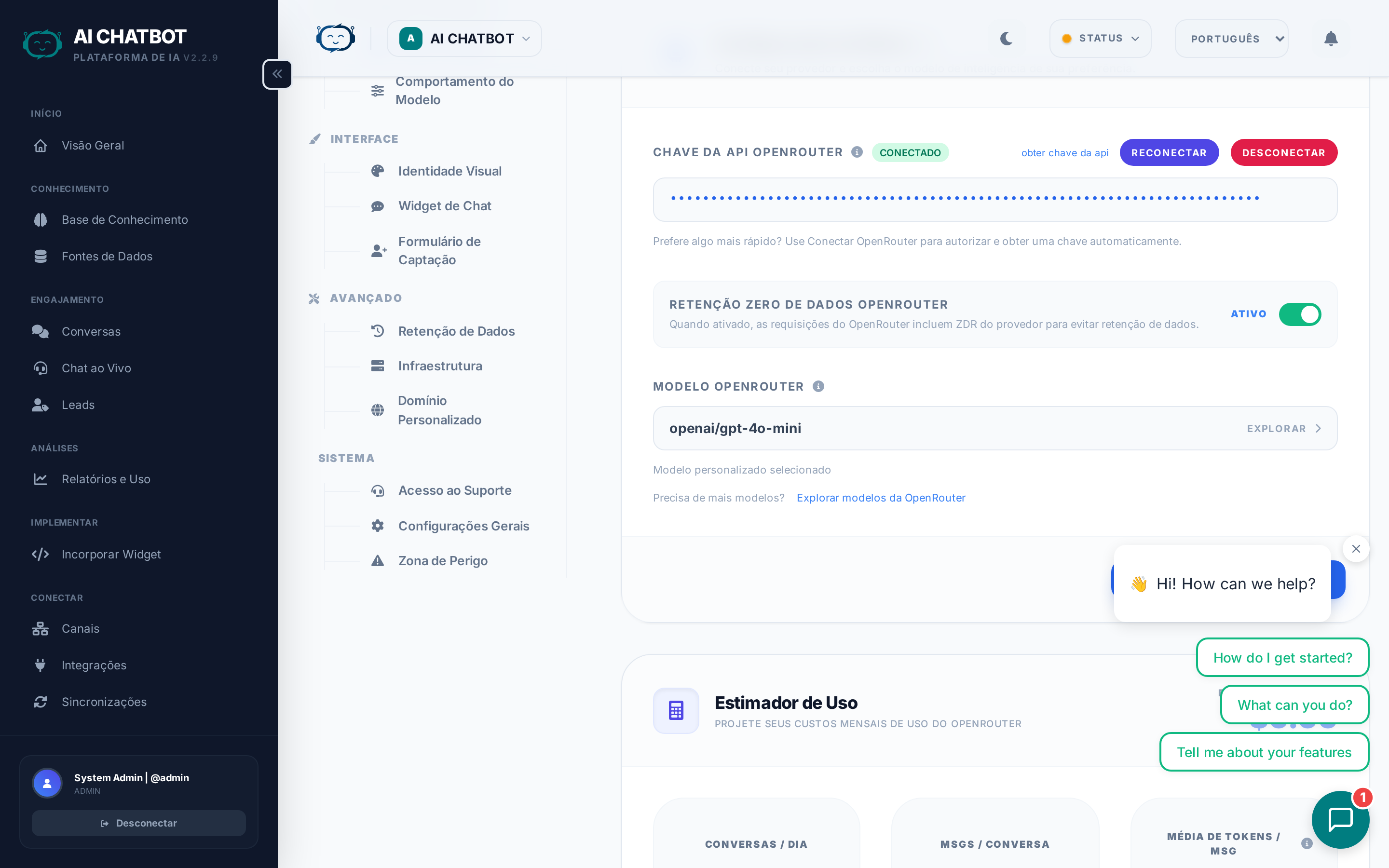

Como conectar seu provedor de IA

- Vá em Settings → AI Engine.

- Clique em Connect OpenRouter (fluxo OAuth).

- Autorize a aplicação quando solicitado.

- Sua chave de API é armazenada de forma segura no banco de dados — não em arquivos de configuração.

Isso é tudo. Agora você pode selecionar qualquer modelo no menu suspenso.

Alternativa: Chave de API

Se preferir não usar o OAuth, você pode colar uma chave de API do OpenRouter diretamente. Vá para openrouter.ai, gere uma chave e insira-a em Settings → AI Engine.

Como escolher um modelo

Abra Settings → AI Engine e use o menu de seleção de modelos. Cada modelo exibe:

- Nome do modelo e provedor (ex: Claude 3.7 Sonnet da Anthropic)

- Tamanho da janela de contexto (quanto texto o modelo pode processar de uma vez)

- Nível de custo relativo (econômico, padrão, premium)

Qual modelo devo escolher?

| Caso de uso | Modelos recomendados | Por que |

|---|---|---|

| Suporte geral ao cliente | GPT-4o, Claude 3.5 Sonnet | Rápido, confiável, custo-benefício |

| Raciocínio complexo e análise | Claude 3.7, GPT-4.5 | Precisão superior em questões difíceis |

| Baixo orçamento / alto volume | DeepSeek V3, GPT-4o Mini | Excelente qualidade por uma fração do custo |

| Documentos massivos (+100k palavras) | Gemini 2.5 Pro | Janela de contexto de até 1M de tokens |

| Chat em tempo real (menor latência) | Gemini Flash, Claude Haiku | Tempos de resposta abaixo de um segundo |

Os três principais provedores

Anthropic (Claude)

- Pontos fortes: Raciocínio superior, diálogo natural, excelente em seguir instruções.

- Ideal para: Suporte ao cliente, geração de conteúdo, Q&A complexo.

- Modelos: Claude 3.7 Sonnet, Claude 3.5 Sonnet, Claude 3.5 Haiku.

OpenAI (GPT)

- Pontos fortes: Confiabilidade padrão da indústria, ecossistema massivo, desempenho consistente.

- Ideal para: IA de propósito geral, uso de ferramentas, saídas estruturadas.

- Modelos: GPT-4o, GPT-4o Mini, GPT-4.5, o1, o3-mini.

Google (Gemini)

- Pontos fortes: Janelas de contexto massivas (até 1M+ tokens), fortes capacidades multimodais.

- Ideal para: Analisar documentos extensos, conversas longas, compreensão de imagens.

- Modelos: Gemini 2.5 Pro, Gemini 2.5 Flash, Gemini 2.0 Flash.

Modelos especializados

| Provedor | Modelos | Ideal para |

|---|---|---|

| xAI (Grok) | Grok 3, Grok 3 Mini | Desempenho de alta velocidade, conhecimento em tempo real |

| DeepSeek | DeepSeek V3, DeepSeek R1 | Inteligência de nível GPT-4 com preço econômico |

| Mistral | Mistral Large, Mistral Medium | IA europeia com forte suporte multilíngue |

| Meta (Llama) | Llama 3.3, Llama 4 | Transparência de pesos abertos, desempenho robusto |

Nossos 4 pilares de critérios de seleção

Cada modelo no FRENZY.BOT é avaliado em relação a quatro requisitos antes de ser adicionado à plataforma:

- Confiabilidade — Tempo de atividade mínimo e consistência. Sem modelos experimentais ou instáveis que possam falhar no meio de uma conversa.

- Janela de contexto — Preferência por 128k+ tokens. Um contexto longo significa que o bot pode referenciar mais da sua base de conhecimento em uma única resposta.

- Relação inteligência/custo — Priorizamos modelos que entregam alta qualidade sem custos desnecessários. DeepSeek e GPT-4o Mini são exemplos primordiais.

- Baixa latência — Variantes Flash e Fast são incluídas especificamente para chats em tempo real com o cliente, onde cada segundo importa.

Novos modelos adicionados rapidamente

Quando um grande provedor lança um novo modelo de ponta, nós o avaliamos e adicionamos dentro de 24 horas após o lançamento estável. Você sempre terá acesso ao que há de mais recente e melhor.

Retenção Zero de Dados (ZDR)

O FRENZY.BOT suporta a aplicação de Retenção Zero de Dados (Zero Data Retention) por solicitação através do OpenRouter.

O que isso significa:

- Quando o ZDR está ativado, seus prompts e respostas nunca são armazenados pelo provedor de IA.

- Seus dados nunca são usados para treinamento de modelos.

- Isso é aplicado no nível da API através do parâmetro

provider.zdr: truedo OpenRouter.

Como ativar o ZDR:

- Vá em Settings → AI Engine.

- Ative a chave Zero Data Retention.

- Todas as solicitações subsequentes incluirão a flag ZDR.

Compatibilidade de modelos com ZDR

Nem todos os modelos suportam ZDR. Quando ativado, o FRENZY.BOT roteia automaticamente as solicitações apenas para provedores que respeitam as políticas de retenção zero de dados. Verifique a documentação de ZDR do OpenRouter para a lista atual.

Configurações de comportamento do modelo

Além de escolher um modelo, você pode ajustar como ele responde:

Temperature

Controla a criatividade vs. precisão.

- Baixa (0.1–0.3): Respostas factuais e determinísticas. Ideal para suporte e questões de política interna.

- Média (0.4–0.7): Equilibrada. Um bom padrão para a maioria dos casos de uso.

- Alta (0.8–1.0): Respostas criativas e variadas. Ideal para brainstorming ou chats casuais.

Top-P

Outro controle para diversidade de respostas. Funciona em conjunto com a temperatura.

- Valores menores: Respostas mais focadas e previsíveis.

- Valores maiores: Uma gama mais ampla de escolhas de palavras.

Max tokens

Limita o comprimento das respostas. Configure isso com base no seu caso de uso:

- Respostas curtas (256–512): Respostas rápidas estilo FAQ.

- Médio (1024–2048): Conversas de suporte padrão.

- Longo (4096+): Explicações detalhadas ou conteúdo técnico.

System prompt

As instruções globais que moldam cada resposta. É aqui que você define:

- A personalidade e o tom do bot

- O que ele deve ou não discutir

- Como ele deve lidar com tópicos específicos

- Preferências de idioma e formatação

Caminho: Settings → Model Behavior → Global System Prompt

Mantenha seu prompt de sistema focado

Os melhores prompts de sistema são curtos, claros e focados em diretrizes. Evite instruções longas e prolixas — elas diluem a atenção do modelo e desperdiçam tokens.

Alterando ou desconectando provedores

Para trocar de modelo

Basta selecionar um modelo diferente no menu suspenso em Settings → AI Engine. A mudança entra em vigor imediatamente para novas conversas.

Para desconectar o OpenRouter

- Vá em Settings → AI Engine.

- Clique em Disconnect.

- O bot parará de responder às perguntas até que um novo provedor seja conectado.

Quando desconectar

- Rotação de chaves de API por segurança.

- Mudança para uma conta de provedor diferente.

- Desativação temporária das respostas de IA durante manutenção.

Perguntas Frequentes (FAQ)

P: A IA parou de responder depois que mudei de modelo.

- Alguns modelos podem estar temporariamente indisponíveis. Mude para um modelo diferente e verifique a página de status do OpenRouter.

P: As respostas estão muito longas / muito curtas.

- Ajuste o Max Tokens em Settings → Model Behavior. Também revise seu prompt de sistema para instruções de comprimento.

P: Quanto custa cada modelo?

- O preço é definido pelo provedor do modelo através do OpenRouter. Verifique openrouter.ai/models para os preços atuais por token. O FRENZY.BOT não adiciona nenhuma taxa extra.

P: Posso usar meu próprio modelo auto-hospedado?

- Atualmente não. O FRENZY.BOT usa o OpenRouter como portal unificado. Se o seu modelo auto-hospedado estiver disponível através do OpenRouter, ele funcionará.